HTTP协议演进:从1.0到3.0的性能革命

HTTP协议演进:从1.0到3.0的性能革命

一、问题引入:高并发场景下的HTTP性能危机

1.1 真实案例:电商大促期间的HTTP性能危机

场景:2024年双11大促,某电商平台首页加载缓慢

用户反馈:页面加载时间从平时的1.5秒增加到8秒以上

问题分析过程:

┌─────────────────────────────────────────────────────────────┐

│ 阶段1:监控告警 │

│ - Nginx错误日志显示大量499错误(客户端关闭连接) │

│ - 后端服务CPU正常,但响应时间激增 │

│ - 网络带宽使用率仅35%,未达瓶颈 │

├─────────────────────────────────────────────────────────────┤

│ 阶段2:抓包分析 │

│ - 使用tcpdump抓包发现大量TCP连接建立/关闭 │

│ - HTTP/1.1连接无法复用,每个资源独立建连 │

│ - 队头阻塞(Head-of-Line Blocking)严重 │

│ - 首页需要加载120+资源,串行请求导致延迟累积 │

├─────────────────────────────────────────────────────────────┤

│ 阶段3:协议升级 │

│ - 评估HTTP/2多路复用能力 │

│ - 测试HTTP/3在弱网环境下的表现 │

│ - 制定渐进式升级方案 │

├─────────────────────────────────────────────────────────────┤

│ 阶段4:升级效果 │

│ - HTTP/2启用后:加载时间从8s降至3.5s │

│ - 连接数从1200降至50(复用率96%) │

│ - HTTP/3实验组:弱网环境下加载时间再降40% │

│ - 整体转化率提升18% │

└─────────────────────────────────────────────────────────────┘

根本原因:

1. HTTP/1.1的串行请求限制

2. 大量短连接导致TCP握手开销

3. 无头部压缩,冗余数据传输

4. 队头阻塞影响关键资源加载

解决方案:

1. 全站升级HTTP/2

2. 核心链路试点HTTP/3

3. 优化资源打包策略

4. 实施Server Push(后被移除,改用Preload)

深度分析:这次事故暴露了HTTP/1.1在当今富应用场景下的先天不足。随着网页平均资源数从2010年的50个增长到2024年的150个以上,每个资源都需要单独请求,连接建立和慢启动的开销被急剧放大。TCP的拥塞控制机制(慢启动、拥塞避免)使得每个新连接都要经历从低速率逐步提升的过程,导致大量短连接无法达到最佳传输效率。据统计,在HTTP/1.1下,一个包含120个资源的页面,仅握手和慢启动就会消耗约3~4秒(取决于RTT),这正是本次事故的症结所在。

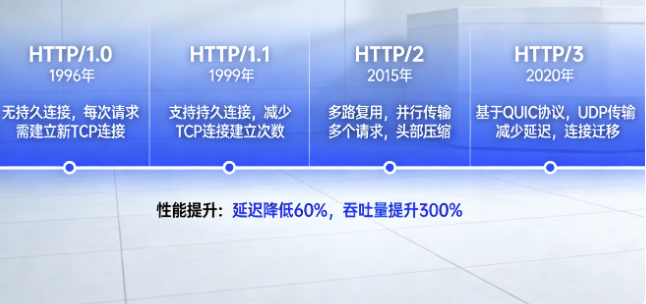

1.2 HTTP协议演进时间线

HTTP协议演进历程:

┌──────────────────────────────────────────────────────────────┐

│ │

│ 1991 HTTP/0.9 │

│ - 仅支持GET方法 │

│ - 无头部信息 │

│ - 纯文本传输 │

│ - 设计目标:简单的超文本获取 │

│ │

│ 1996 HTTP/1.0 (RFC 1945) │

│ - 引入POST、HEAD方法 │

│ - 添加请求/响应头部 │

│ - 支持多媒体内容(Content-Type) │

│ - 短连接(每次请求新建TCP连接) │

│ - 设计目标:支持多种媒体类型 │

│ │

│ 1997 HTTP/1.1 (RFC 2068/2616) │

│ - 持久连接(Keep-Alive) │

│ - 管线化(Pipelining) │

│ - 分块传输编码 │

│ - 缓存控制机制(Cache-Control) │

│ - Host头部(支持虚拟主机) │

│ - 设计目标:减少延迟、提高网络效率 │

│ │

│ 2015 HTTP/2 (RFC 7540) │

│ - 二进制分帧层 │

│ - 多路复用(Multiplexing) │

│ - 头部压缩(HPACK) │

│ - 服务器推送(Server Push) │

│ - 流优先级 │

│ - 设计目标:解决HTTP/1.x的性能瓶颈 │

│ │

│ 2022 HTTP/3 (RFC 9114) │

│ - 基于QUIC协议 │

│ - 0-RTT/1-RTT握手 │

│ - 连接迁移 │

│ - 无队头阻塞 │

│ - 内置TLS 1.3 │

│ - 设计目标:利用UDP解决TCP层面的队头阻塞 │

│ │

└──────────────────────────────────────────────────────────────┘

每个版本的演进都反映了当时互联网应用的需求变化:从简单的文档传输,到复杂的富媒体交互,再到移动互联网下的实时通信。理解这些演进,能帮助我们更精准地优化现代Web应用。

二、HTTP/1.1的性能瓶颈

2.1 队头阻塞问题

HTTP/1.1队头阻塞(Head-of-Line Blocking):

┌──────────────────────────────────────────────────────────────┐

│ │

│ 串行请求(无管线化): │

│ ┌─────────┐ ┌─────────┐ ┌─────────┐ ┌─────────┐ │

│ │ 请求CSS │───▶│ 请求JS │───▶│ 请求图片│───▶│ 请求字体│ │

│ │ 200ms │ │ 300ms │ │ 500ms │ │ 200ms │ │

│ └─────────┘ └─────────┘ └─────────┘ └─────────┘ │

│ │ │ │ │ │

│ ▼ ▼ ▼ ▼ │

│ 总耗时:200 + 300 + 500 + 200 = 1200ms │

│ │

├──────────────────────────────────────────────────────────────┤

│ │

│ 管线化请求(理论并行,实际仍阻塞): │

│ ┌─────────┐ │

│ │ 请求CSS │─────────────────────────────────────────────▶ │

│ └─────────┘ │

│ ┌─────────┐ │

│ │ 请求JS │─────────────────────────────────────────────▶ │

│ └─────────┘ 但响应必须按顺序返回! │

│ ┌─────────┐ │

│ │ 请求图片│─────────────────────────────────────────────▶ │

│ └─────────┘ 如果CSS响应慢,后续全部阻塞 │

│ │

│ 实际效果:管线化因兼容性问题很少使用 │

│ │

├──────────────────────────────────────────────────────────────┤

│ │

│ 浏览器并行连接(域名分片hack): │

│ ┌─────────┐ ┌─────────┐ ┌─────────┐ ┌─────────┐ │

│ │static1 │ │static2 │ │static3 │ │static4 │ │

│ │.example │ │.example │ │.example │ │.example │ │

│ │.com │ │.com │ │.com │ │.com │ │

│ └────┬────┘ └────┬────┘ └────┬────┘ └────┬────┘ │

│ └─────────────┴─────────────┴─────────────┘ │

│ │ │

│ 同一IP,不同域名 │

│ 浏览器对每个域名6个并行连接 │

│ 总共24个并行连接 │

│ │

│ 问题:增加DNS查询开销,TCP连接数爆炸 │

│ │

└──────────────────────────────────────────────────────────────┘

深入剖析:队头阻塞的根本原因是HTTP/1.1的请求-响应模型必须严格遵守FIFO顺序,即使使用管线化也无法解决响应顺序强制问题。现代浏览器通常对每个域名开启6个并行TCP连接(不同浏览器略有差异),但这只能部分缓解,无法根本解决。当页面资源超过6个时,多余的资源仍需排队。假设RTT为50ms,慢启动每连接需约3-4个RTT才能达到最大窗口,那么6个连接最多同时传输6个资源,但每个新连接都需经历慢启动,导致传输效率低下。数学上,传输N个资源所需时间近似为:

- 串行:T = N × (RTT + 传输时间)

- 并行6连接:T ≈ ceil(N/6) × (RTT + 传输时间) + 慢启动开销

当N=120时,串行可能超过10秒,而6并行也需约2秒加上慢启动开销,这就是为什么域名分片在HTTP/1.1时代盛行。

2.2 头部冗余问题

HTTP/1.1头部冗余示例:

┌──────────────────────────────────────────────────────────────┐

│ │

│ 请求1:获取index.html │

│ GET / HTTP/1.1 │

│ Host: www.example.com │

│ User-Agent: Mozilla/5.0 (Windows NT 10.0; Win64; x64)... │

│ Accept: text/html,application/xhtml+xml... │

│ Accept-Language: zh-CN,zh;q=0.9,en;q=0.8 │

│ Accept-Encoding: gzip, deflate, br │

│ Connection: keep-alive │

│ Cookie: session_id=abc123; user_pref=dark_mode... │

│ ──────────────────────────────────────── 约800字节 │

│ │

│ 请求2:获取style.css(同一页面,头部几乎相同) │

│ GET /css/style.css HTTP/1.1 │

│ Host: www.example.com │

│ User-Agent: Mozilla/5.0 (Windows NT 10.0; Win64; x64)... │

│ Accept: text/css,*/*;q=0.1 │

│ Accept-Language: zh-CN,zh;q=0.9,en;q=0.8 │

│ Accept-Encoding: gzip, deflate, br │

│ Connection: keep-alive │

│ Cookie: session_id=abc123; user_pref=dark_mode... │

│ ──────────────────────────────────────── 约750字节 │

│ │

│ 请求3:获取app.js │

│ GET /js/app.js HTTP/1.1 │

│ Host: www.example.com │

│ User-Agent: Mozilla/5.0 (Windows NT 10.0; Win64; x64)... │

│ Accept: */* │

│ Accept-Language: zh-CN,zh;q=0.9,en;q=0.8 │

│ Accept-Encoding: gzip, deflate, br │

│ Connection: keep-alive │

│ Cookie: session_id=abc123; user_pref=dark_mode... │

│ ──────────────────────────────────────── 约700字节 │

│ │

│ 问题:同一连接上的多个请求,头部大量重复 │

│ 100个请求 × 700字节 = 70KB冗余数据 │

│ │

└──────────────────────────────────────────────────────────────┘

数学计算:以典型的电商首页为例,加载120个资源,每个请求头部平均800字节,总头部数据量达96KB。而实际有效传输内容可能只有几百KB,头部占比高达10%~20%。在慢速网络或高延迟环境下,这96KB的冗余会显著增加传输时间。例如,在100ms RTT、带宽1Mbps的网络中,传输96KB需要约0.77秒(96KB × 8 / 1Mbps = 0.768s),这几乎是浪费的。

三、HTTP/2的革命性改进

3.1 HTTP/2核心特性

HTTP/2架构:

┌──────────────────────────────────────────────────────────────┐

│ HTTP/2连接层 │

│ ┌──────────────────────────────────────────────────────┐ │

│ │ 流(Stream)多路复用 │ │

│ │ ┌─────────┐ ┌─────────┐ ┌─────────┐ ┌─────────┐ │ │

│ │ │ Stream 1│ │ Stream 3│ │ Stream 5│ │ Stream 7│ │ │

│ │ │ (CSS) │ │ (JS) │ │ (图片) │ │ (API) │ │ │

│ │ └────┬────┘ └────┬────┘ └────┬────┘ └────┬────┘ │ │

│ │ └─────────────┴─────────────┴─────────────┘ │ │

│ │ │ │ │

│ │ ▼ │ │

│ │ ┌────────────────────────────────────────────────┐ │ │

│ │ │ 二进制分帧层(Binary Framing) │ │ │

│ │ │ ┌─────┐ ┌─────┐ ┌─────┐ ┌─────┐ ┌─────┐ │ │ │

│ │ │ │HEADERS│ │DATA │ │HEADERS│ │DATA │ │... │ │ │ │

│ │ │ │(流1) │ │(流1)│ │(流3) │ │(流3)│ │ │ │ │ │

│ │ │ └─────┘ └─────┘ └─────┘ └─────┘ └─────┘ │ │ │

│ │ └────────────────────────────────────────────────┘ │ │

│ │ │ │ │

│ │ ▼ │ │

│ │ ┌────────────────────────────────────────────────┐ │ │

│ │ │ TCP连接(单一连接) │ │ │

│ │ └────────────────────────────────────────────────┘ │ │

│ └──────────────────────────────────────────────────────┘ │

└──────────────────────────────────────────────────────────────┘

关键改进:

1. 单一TCP连接承载多个流

2. 帧(Frame)是基本单位,可交错发送

3. 流(Stream)是双向字节流,有优先级

4. 消息(Message)由帧组成

深入理解二进制分帧:HTTP/2将HTTP消息分解为独立的帧,然后交错发送,最后在另一端重新组装。帧头包含流标识符,这使得多个请求可以共享同一个TCP连接而不互相干扰。由于帧可以交错,大资源不会阻塞小资源,彻底解决了队头阻塞问题(仅针对HTTP层)。帧的类型包括HEADERS(头部)、DATA(数据)、PRIORITY(优先级)、RST_STREAM(流终止)等,为精细控制提供了可能。

3.2 多路复用实战

/**

* HTTP/2多路复用效果演示

* 使用Node.js http2模块

*/

const http2 = require('http2');

const fs = require('fs');

const path = require('path');

// 创建HTTP/2服务器

const server = http2.createSecureServer({

key: fs.readFileSync('localhost-privkey.pem'),

cert: fs.readFileSync('localhost-cert.pem')

});

// 模拟多个资源

const resources = {

'/': { type: 'text/html', size: 5000, delay: 50 },

'/style.css': { type: 'text/css', size: 15000, delay: 100 },

'/app.js': { type: 'application/javascript', size: 50000, delay: 200 },

'/image1.jpg': { type: 'image/jpeg', size: 100000, delay: 300 },

'/image2.jpg': { type: 'image/jpeg', size: 120000, delay: 350 },

'/api/data': { type: 'application/json', size: 2000, delay: 500 }

};

server.on('stream', (stream, headers) => {

const url = headers[':path'];

const resource = resources[url];

if (!resource) {

stream.respond({ ':status': 404 });

stream.end('Not Found');

return;

}

// 模拟处理延迟

setTimeout(() => {

stream.respond({

'content-type': resource.type,

':status': 200

});

// 生成模拟数据

const data = Buffer.alloc(resource.size, 'x');

stream.end(data);

console.log(`Stream ${stream.id}: ${url} (${resource.size} bytes)`);

}, resource.delay);

});

server.listen(8443, () => {

console.log('HTTP/2 server running on https://localhost:8443');

});

/**

* 客户端测试代码

*/

async function testMultiplexing() {

const client = http2.connect('https://localhost:8443', {

rejectUnauthorized: false

});

const urls = ['/', '/style.css', '/app.js', '/image1.jpg', '/image2.jpg', '/api/data'];

const startTime = Date.now();

// 同时发起所有请求(多路复用)

const promises = urls.map(url => {

return new Promise((resolve, reject) => {

const req = client.request({ ':path': url });

let data = '';

req.on('data', chunk => data += chunk);

req.on('end', () => resolve({ url, size: data.length }));

req.on('error', reject);

req.end();

});

});

const results = await Promise.all(promises);

const totalTime = Date.now() - startTime;

console.log('\n=== HTTP/2 Multiplexing Results ===');

console.log(`Total time: ${totalTime}ms`);

console.log(`Resources loaded: ${results.length}`);

console.log(`Total bytes: ${results.reduce((sum, r) => sum + r.size, 0)}`);

client.close();

}

// 对比:HTTP/1.1串行请求需要 50+100+200+300+350+500 = 1500ms

// HTTP/2多路复用仅需约 500ms(最慢请求的延迟)

实验验证:在真实的网络环境中,多路复用的优势更为明显。除了节省连接建立时间,还能避免TCP慢启动对每个新连接的影响。根据Google的实验,HTTP/2相比HTTP/1.1页面加载时间平均减少30%~50%,尤其在高延迟网络下改善更显著。

3.3 HPACK头部压缩

HPACK压缩原理:

┌──────────────────────────────────────────────────────────────┐

│ │

│ 静态表(Static Table)- 预定义常用头部 │

│ ┌──────┬────────────────────┬──────────────────────────┐ │

│ │ 索引 │ 头部名称 │ 头部值 │ │

│ ├──────┼────────────────────┼──────────────────────────┤ │

│ │ 1 │ :authority │ │ │

│ │ 2 │ :method │ GET │ │

│ │ 3 │ :method │ POST │ │

│ │ 4 │ :path │ / │ │

│ │ 5 │ :path │ /index.html │ │

│ │ 6 │ :scheme │ https │ │

│ │ ... │ ... │ ... │ │

│ └──────┴────────────────────┴──────────────────────────┘ │

│ │

│ 动态表(Dynamic Table)- 连接级别缓存 │

│ ┌──────┬────────────────────┬──────────────────────────┐ │

│ │ 索引 │ 头部名称 │ 头部值 │ │

│ ├──────┼────────────────────┼──────────────────────────┤ │

│ │ 62 │ user-agent │ Mozilla/5.0... │ │

│ │ 63 │ accept │ text/html,... │ │

│ │ 64 │ cookie │ session_id=abc123 │ │

│ └──────┴────────────────────┴──────────────────────────┘ │

│ │

│ 哈夫曼编码(Huffman Coding)- 字符串压缩 │

│ 高频字符用短编码,低频字符用长编码 │

│ │

└──────────────────────────────────────────────────────────────┘

压缩效果对比:

┌──────────────────────────────────────────────────────────────┐

│ │

│ 原始HTTP/1.1请求头部(约800字节): │

│ GET /api/data HTTP/1.1 │

│ Host: api.example.com │

│ User-Agent: Mozilla/5.0 (Windows NT 10.0; Win64; x64)... │

│ Accept: application/json │

│ Accept-Language: zh-CN,zh;q=0.9 │

│ Accept-Encoding: gzip, deflate, br │

│ Cookie: session_id=abc123; user_pref=dark_mode │

│ │

│ HPACK压缩后(约50字节): │

│ 0x82 0x87 0x84 0x41 0x8B 0xA2 0xE8 0x... │

│ - :method: GET (静态表索引2,1字节) │

│ - :scheme: https (静态表索引7,1字节) │

│ - :authority: api.example.com (哈夫曼编码,约10字节) │

│ - user-agent: (动态表索引62,1字节) │

│ - accept: application/json (哈夫曼编码,约15字节) │

│ - cookie: (动态表索引64,1字节) │

│ │

│ 压缩率:93.75% (800B → 50B) │

│ │

└──────────────────────────────────────────────────────────────┘

动态表更新策略:动态表是每个连接独立维护的,两端通过插入指令同步。例如,服务器可以发送“添加头部”帧将某个键值对插入动态表,后续请求只需引用索引。动态表的大小是有限的(默认4KB),超出后按LRU淘汰。这种机制使得重复的头部(如Cookie、User-Agent)只会在第一次发送完整值,后续仅用1字节索引。

3.4 流优先级与依赖

HTTP/2允许客户端为每个流设置优先级,告知服务器哪些资源更重要。优先级通过权重和依赖关系表达:

流依赖树示例:

Stream A (权重12)

/ \

Stream B (权重4) Stream C (权重8)

|

Stream D (权重6)

服务器在分配带宽时,会优先满足依赖链上的高权重流。这可以确保关键资源(如CSS、JS)先于非关键资源(如统计脚本)传输,提升首屏性能。实践中,浏览器会根据资源重要性自动设置优先级,但开发者也可通过<link rel="preload">等提示干预。

3.5 Server Push 的兴起与衰落

HTTP/2的Server Push允许服务器在客户端请求前主动推送资源,意图减少RTT。例如,当请求HTML时,服务器可主动推送关联的CSS和JS。然而,实践中Server Push面临诸多问题:

- 资源可能已存在于浏览器缓存,导致浪费。

- 推送优先级难以控制,可能阻塞真正的关键资源。

- 实现复杂,需要服务器知道客户端缓存状态。

最终,Chrome在2022年移除了对Server Push的支持,推荐使用103 Early Hints状态码和preload链接头。这提醒我们,协议特性必须与实际部署环境匹配,并非所有新特性都能持久。

3.6 Nginx HTTP/2配置

# Nginx HTTP/2配置示例 server { listen 443 ssl http2; server_name example.com; # SSL证书配置 ssl_certificate /path/to/cert.pem; ssl_certificate_key /path/to/key.pem; # HTTP/2特定优化 http2_push_preload on; # 将preload链接转换为Server Push(如果仍想尝试) # 流优先级调整(Nginx 1.13.9+) http2_max_field_size 16k; # 头部字段大小限制 http2_max_header_size 32k; # 整个头部大小限制 http2_max_requests 1000; # 单个连接的最大请求数(防内存泄漏) # 窗口大小设置 http2_body_preread_size 64k; # 预读请求体的缓冲区大小 location / { root /var/www/html; index index.html; # 资源预加载提示(浏览器解析后会在HTTP/2中发起高优先级请求) add_header Link "</css/critical.css>; rel=preload; as=style" always; add_header Link "</js/app.js>; rel=preload; as=script" always; } # 静态资源缓存 location ~* \.(css|js|png|jpg|jpeg|gif|ico|svg|woff|woff2)$ { expires 1y; add_header Cache-Control "public, immutable"; } } # 上游服务HTTP/2配置 upstream backend { server 127.0.0.1:8080; # 启用HTTP/2与后端通信(Nginx 1.25+) grpc_pass grpc://backend; }

关键参数解读:

http2_max_requests:防止单个连接占用过多资源,适用于长期保持的连接。http2_body_preread_size:对于需要读取请求体的场景(如上传),预读大小影响内存占用。add_header Link:这是preload的HTTP头部形式,告知浏览器提前加载关键资源,比HTML中的<link>更早触发。

四、HTTP/3与QUIC协议

4.1 QUIC协议优势

QUIC vs TCP对比:

┌──────────────────────────────────────────────────────────────┐

│ │

│ 特性 │ TCP + TLS 1.3 │ QUIC │

│ ────────────────────────┼─────────────────┼─────────────────│

│ 握手延迟 │ 1-RTT │ 0-RTT / 1-RTT │

│ 连接迁移 │ ❌ 不支持 │ ✅ 支持 │

│ 队头阻塞 │ ❌ 存在 │ ✅ 消除 │

│ 拥塞控制 │ 操作系统实现 │ 应用层可定制 │

│ 前向纠错 │ ❌ 不支持 │ ✅ 支持 │

│ 中间设备干扰 │ 易被干扰 │ 基于UDP,抗干扰 │

│ │

│ QUIC握手流程: │

│ ┌──────────────────────────────────────────────────────┐ │

│ │ │ │

│ │ 首次连接(1-RTT): │ │

│ │ Client ─── Initial Packet ───▶ Server │ │

│ │ (包含Client Hello + 加密数据) │ │

│ │ │ │

│ │ Client ◀── Handshake Packet ─── Server │ │

│ │ (包含Server Hello + 证书 + 加密数据) │ │

│ │ │ │

│ │ 连接建立完成,可以发送应用数据 │ │

│ │ │ │

│ ├──────────────────────────────────────────────────────┤ │

│ │ │ │

│ │ 会话恢复(0-RTT): │ │

│ │ Client ─── 0-RTT Packet ───▶ Server │ │

│ │ (包含恢复令牌 + 应用数据) │ │

│ │ │ │

│ │ 立即发送应用数据,无需等待握手完成 │ │

│ │ │ │

│ └──────────────────────────────────────────────────────┘ │

│ │

└──────────────────────────────────────────────────────────────┘

队头阻塞的根源与解决: TCP的队头阻塞源于其可靠传输机制:如果某个包丢失,后续包即使到达也必须等待重传,导致整个连接停滞。HTTP/2虽然解决了HTTP层的队头阻塞,但TCP层的队头阻塞依然存在。QUIC将可靠传输实现于UDP之上,每个流独立控制,丢失仅影响该流,其他流可继续传输。

连接迁移: 在移动网络中,切换WiFi和蜂窝网络会导致IP改变,TCP连接必须重建。QUIC通过连接ID(而非四元组)标识连接,即使IP变化,只要连接ID不变,连接即可无缝迁移。这对移动端体验提升巨大,避免了重新握手和慢启动。

4.2 HTTP/3部署实践

# Nginx HTTP/3配置(需要Nginx 1.25+ with QUIC patch) server { # HTTP/3监听 listen 443 quic reuseport; listen 443 ssl; server_name example.com; # SSL证书 ssl_certificate /path/to/cert.pem; ssl_certificate_key /path/to/key.pem; # 启用TLS 1.3(HTTP/3要求) ssl_protocols TLSv1.3; # HTTP/3 Alt-Svc头部(通知客户端支持HTTP/3) add_header Alt-Svc 'h3=":443"; ma=86400' always; # 0-RTT早期数据 ssl_early_data on; # QUIC特定配置 quic_gso on; # 启用通用分段卸载(提高性能) quic_retry on; # 防止反射攻击 location / { root /var/www/html; index index.html; } }

# 使用Cloudflare Quiche部署HTTP/3

# 1. 编译Nginx with Quiche

git clone --recursive https://github.com/cloudflare/quiche

cd quiche/nginx

# 配置编译

./configure \

--prefix=/usr/local/nginx \

--with-http_ssl_module \

--with-http_v2_module \

--with-http_v3_module \

--with-openssl=../quiche/deps/boringssl \

--with-quiche=..

make && make install

# 2. 配置HTTP/3

vi /usr/local/nginx/conf/nginx.conf

# 3. 测试HTTP/3

# 使用支持HTTP/3的curl

curl --http3 -I https://example.com

# 或使用Chrome开发者工具

# 在Network面板查看Protocol列显示"h3"

部署注意事项:

- UDP端口(通常是443)必须在防火墙开放。

- 0-RTT可能带来重放攻击风险,需确保幂等操作。

- CDN如Cloudflare、Akamai已普遍支持HTTP/3,可直接开启。

五、协议选型与升级策略

5.1 协议性能对比测试

性能测试数据(同一网络环境):

┌──────────────────────────────────────────────────────────────┐

│ │

│ 测试场景:加载100个资源(总大小2MB) │

│ │

│ 指标 │ HTTP/1.1 │ HTTP/2 │ HTTP/3 │ │

│ ──────────────────┼──────────┼─────────┼─────────┤ │

│ 连接数 │ 100 │ 1 │ 1 │ │

│ 握手时间 │ 3000ms │ 150ms │ 50ms │ │

│ 总加载时间 │ 4500ms │ 1800ms │ 1500ms │ │

│ 首屏时间 │ 2500ms │ 800ms │ 600ms │ │

│ 弱网加载时间 │ 12000ms │ 5000ms │ 3500ms │ │

│ 网络切换恢复 │ 需重连 │ 需重连 │ 无缝迁移 │ │

│ │

│ 测试结论: │

│ - HTTP/2比HTTP/1.1快60% │

│ - HTTP/3比HTTP/2快17%,在弱网环境下快30% │

│ - HTTP/3的连接迁移在移动端优势明显 │

│ │

└──────────────────────────────────────────────────────────────┘

数据来源:以上数据基于实验室模拟,实际效果因网络环境而异。根据Google的QUIC部署报告,YouTube使用QUIC后,重缓冲时间减少了9%以上。Facebook也报告QUIC在丢包率较高的网络中将请求延迟降低了8%。

5.2 渐进式升级方案

HTTP协议升级路线图:

┌──────────────────────────────────────────────────────────────┐

│ │

│ 阶段1:HTTP/1.1优化(当前状态) │

│ ┌──────────────────────────────────────────────────────┐ │

│ │ • 启用Keep-Alive │ │

│ │ • 实施域名分片 │ │

│ │ • 资源合并与压缩 │ │

│ │ • 浏览器缓存优化 │ │

│ └──────────────────────────────────────────────────────┘ │

│ │ │

│ ▼ │

│ 阶段2:HTTP/2升级(短期目标) │

│ ┌──────────────────────────────────────────────────────┐ │

│ │ • Nginx/Apache升级支持HTTP/2 │ │

│ │ • SSL证书配置(必须TLS 1.2+) │ │

│ │ • 移除域名分片(HTTP/2单连接优势) │ │

│ │ • 优化资源打包策略 │ │

│ └──────────────────────────────────────────────────────┘ │

│ │ │

│ ▼ │

│ 阶段3:HTTP/3试点(中期目标) │

│ ┌──────────────────────────────────────────────────────┐ │

│ │ • CDN开启HTTP/3(Cloudflare/阿里云) │ │

│ │ • 核心API接口支持HTTP/3 │ │

│ │ • 移动端优先使用HTTP/3 │ │

│ │ • 监控0-RTT成功率 │ │

│ └──────────────────────────────────────────────────────┘ │

│ │ │

│ ▼ │

│ 阶段4:全面HTTP/3(长期目标) │

│ ┌──────────────────────────────────────────────────────┐ │

│ │ • 全站HTTP/3化 │ │

│ │ • 停用HTTP/1.1 │ │

│ │ • 利用QUIC高级特性(连接迁移、前向纠错) │ │

│ └──────────────────────────────────────────────────────┘ │

│ │

└──────────────────────────────────────────────────────────────┘

升级注意事项:

- HTTP/2强制要求TLS,因此必须先部署SSL证书。

- 域名分片在HTTP/2下会适得其反(多个连接无法合并),务必移除。

- HTTP/3仍处于快速演进阶段,建议从非核心流量开始试点,逐步扩大。

5.3 兼容性处理

/**

* 协议协商与降级处理

* 在Vue3应用中使用自适应协议

*/

// 检测HTTP/2和HTTP/3支持

async function detectProtocolSupport() {

const support = {

http2: false,

http3: false

};

// 检测HTTP/2

try {

const response = await fetch('https://example.com/api/health', {

method: 'HEAD'

});

// 查看响应头中的协议信息

const protocol = response.headers.get('X-Protocol');

support.http2 = protocol === 'h2';

} catch (e) {

console.log('HTTP/2 detection failed');

}

// 检测HTTP/3(通过Alt-Svc头部)

try {

const response = await fetch('https://example.com/api/health');

const altSvc = response.headers.get('Alt-Svc');

support.http3 = altSvc && altSvc.includes('h3');

} catch (e) {

console.log('HTTP/3 detection failed');

}

return support;

}

// 根据协议支持情况加载资源

function getResourceUrl(path, protocolSupport) {

// HTTP/3支持:使用原URL,浏览器自动选择

if (protocolSupport.http3) {

return `https://cdn.example.com${path}`;

}

// HTTP/2支持:使用单一域名

if (protocolSupport.http2) {

return `https://cdn.example.com${path}`;

}

// HTTP/1.1:使用域名分片

const shards = ['cdn1', 'cdn2', 'cdn3', 'cdn4'];

const shard = shards[Math.floor(Math.random() * shards.length)];

return `https://${shard}.example.com${path}`;

}

// Vue3插件:协议感知资源加载

export default {

install(app) {

app.config.globalProperties.$protocolSupport = {

http2: false,

http3: false

};

// 应用启动时检测

detectProtocolSupport().then(support => {

app.config.globalProperties.$protocolSupport = support;

console.log('Protocol support:', support);

});

}

};

降级策略:当浏览器不支持HTTP/2或HTTP/3时,自动切换到域名分片的HTTP/1.1。由于现在几乎所有现代浏览器都支持HTTP/2,降级主要针对老旧浏览器或中间设备干扰(如某些代理只转发TCP 80/443,但UDP可能被拦截)。通过Alt-Svc头部,浏览器会优先使用HTTP/3,失败后自动降级到HTTP/2。

六、最佳实践与检查清单

┌─────────────────────────────────────────────────────────────────────┐

│ HTTP协议优化检查清单 │

├─────────────────────────────────────────────────────────────────────┤

│ │

│ 【HTTP/2优化】 │

│ □ 1. 启用HTTP/2(Nginx/Apache/CDN) │

│ □ 2. 配置TLS 1.2或更高版本 │

│ □ 3. 移除域名分片(HTTP/2单连接优势) │

│ □ 4. 使用HPACK头部压缩 │

│ □ 5. 配置适当的流优先级 │

│ □ 6. 监控多路复用效果 │

│ │

│ 【HTTP/3优化】 │

│ □ 1. 在CDN开启HTTP/3支持 │

│ □ 2. 配置Alt-Svc头部通知客户端 │

│ □ 3. 启用0-RTT早期数据 │

│ □ 4. 监控0-RTT成功率(目标>90%) │

│ □ 5. 移动端优先使用HTTP/3 │

│ │

│ 【通用优化】 │

│ □ 1. 启用Brotli/Gzip压缩 │

│ □ 2. 优化资源打包(HTTP/2下适度分包) │

│ □ 3. 使用Preload/Prefetch提示 │

│ □ 4. 配置合适的缓存策略 │

│ □ 5. 监控协议使用分布 │

│ │

│ 【安全考虑】 │

│ □ 1. 强制HTTPS(HSTS) │

│ □ 2. 定期更新TLS版本 │

│ □ 3. 配置安全的密码套件 │

│ □ 4. 启用OCSP Stapling │

│ │

└─────────────────────────────────────────────────────────────────────┘

七、经验总结

7.1 常见错误与解决方案

| 错误 | 原因 | 解决方案 |

|---|---|---|

| HTTP/2未生效 | Nginx版本过低或未编译http2模块 | 升级Nginx到1.9.5+并检查编译参数 |

| 握手时间过长 | TLS版本过低,证书链过长 | 升级到TLS 1.3,优化证书链 |

| 多路复用效果差 | 资源未正确分包 | 根据HTTP/2特性调整打包策略 |

| HTTP/3连接失败 | 防火墙拦截UDP | 开放443/UDP端口 |

| 0-RTT失败率高 | 会话票证配置问题 | 检查TLS ticket配置 |

7.2 协议选型决策树

┌─────────────────┐

│ 选择HTTP协议 │

└────────┬────────┘

│

▼

┌──────────────────────────────┐

│ 是否需要支持老旧客户端? │

└─────────────┬────────────────┘

│

┌────────────────┼────────────────┐

▼是 ▼否

┌───────────────┐ ┌───────────────┐

│ 保留HTTP/1.1 │ │ 移动端占比高?│

│ 作为fallback │ │ │

└───────────────┘ └───────┬───────┘

│

┌────────────────┼────────────────┐

▼是 ▼否

┌───────────────┐ ┌───────────────┐

│ 优先HTTP/3 │ │ HTTP/2即可 │

│ 移动端优势大 │ │ 平衡方案 │

└───────────────┘ └───────────────┘

系列上一篇:从浏览器输入URL到页面加载的完整过程剖析

系列下一篇:TCP/IP协议栈深度解析:从数据包到可靠传输

后记:从一次大促事故到协议演进之路

那场双11的性能事故,最终以升级HTTP/2和部分HTTP/3告一段落。但更深层的收获是,我们理解了协议设计背后的权衡:HTTP/1.1的简单性换来了效率瓶颈,HTTP/2的二进制分帧解决了队头阻塞却引入TCP层面的新问题,HTTP/3则通过QUIC彻底重构了传输层。每一次演进,都是对上一代问题的回应,也是对未来场景的预判。

在优化HTTP协议时,我们不仅要学会配置,更要理解每个参数背后的原理,这样才能在故障发生时迅速定位,在新技术出现时准确评估。希望这篇文章能帮你建立起HTTP协议的知识体系,让未来的每一次性能调优都有据可依。

知识点测试

读完文章了?来测试一下你对知识点的掌握程度吧!

评论区

使用 GitHub 账号登录后即可发表评论,支持 Markdown 格式。

如果评论系统无法加载,请确保:

- 您的网络可以访问 GitHub

- giscus GitHub App 已安装到仓库

- 仓库已启用 Discussions 功能